たった1枚の写真で自宅がバレる? ChatGPTの画像分析がもはや探偵レベルという話があったので、確認してみました。

自宅を当てられたとかあるので、自宅周りで当てられてしまうとやばいのでとりあえず、やばくない写真で。

アウトプットは以下のものです。

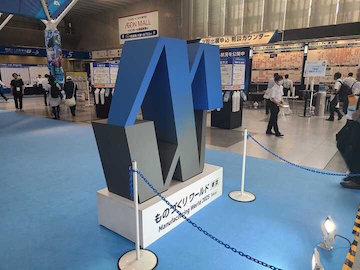

この写真は、**東京ビッグサイト(Tokyo Big Sight)で開催されている「ものづくりワールド東京 2025(Manufacturing World 2025 Tokyo)」**の会場内で撮影されたものです。

写真の手がかり:

前景に大きな「M」の立体オブジェ(Manufacturingの"M")と「ものづくりワールド東京 2025」の表示。

背景の案内表示には「東展示棟(東ホール)」や「Hall 5」とあり、これは東京ビッグサイトの会場構成に一致します。

上部に「イオンモール 幕張新都心まで750m」という案内もありますが、これは来場者向けの地理案内で、イベント開催場所自体は東京ビッグサイトと思われます(幕張メッセとの混同を避けるためにも、他の看板や出展ブースのデザインから判断しています)。

このイベントは製造業向けの大規模な展示会で、毎年多くの企業が参加し、製品・技術の展示や商談が行われます。

一見、正しそうなアウトプットですが、大いに間違っています。まず、「ものづくりワールド東京 2025(Manufacturing World 2025 Tokyo)」というのは正しいですが、ここは東京ビッグサイトではありません。幕張メッセです。これは、ものづくりワールド東京 2025の情報を調べればわかります。

また、もっと問題なのはせっかく見つけたものを無為にしていることです。

上部に「イオンモール 幕張新都心まで750m」という案内もありますが、これは来場者向けの地理案内で、イベント開催場所自体は東京ビッグサイトと思われます(幕張メッセとの混同を避けるためにも、他の看板や出展ブースのデザインから判断しています)。

イオンモール 幕張新都心まで750mという明確な事実を前にして、それを無理に合理化しようとする挙動は、AIが事実を誤解釈し、あたかももっともらしい「嘘」を生成していることです。

つまり、二つの大きな問題があります。

確実な情報の確認不足(「ものづくりワールド2025」を検索しなかった点)

- イベント名と年号という、最も信頼性の高い手がかりがあったにもかかわらず、それを直接検索して公式情報を確認するプロセスが欠けた。

- AIは大量のデータから推論しますが、「これは一次情報源で確認すべき」という判断ができなかった。

検出した重要な情報の活用不足(「イオンモール幕張新都心まで750m」を無為にした点)

非常に具体的で場所を特定する上で決定的な情報があったにもかかわらず、それを矛盾すると判断して無理に排除したり、別の意味に解釈しようとしたりした。

AIが情報を検出する能力と、その情報の「意味合い」「重要度」「他の情報との整合性」を正しく評価する能力の間には、まだ大きなギャップがあることを示している。特に、矛盾する情報をどのように扱うかという点が課題となります。

いわば、Prolog的に言えばバックトラックをやらなかったようなもの。

Prologのような論理プログラミングでは、あるゴールを達成しようとする際に、現在のパスで矛盾が生じたり、条件を満たさなくなったりした場合、それまでの選択をさかのぼって、別の選択肢を試す「バックトラック」というメカニズムが重要です。

今回のAIの挙動は、

- 「ものづくりワールド東京」から「東京ビッグサイト」という初期の仮説(選択肢)を立てた。

- しかし、「イオンモール幕張新都心まで750m」というその仮説と矛盾する明確な情報(失敗条件)に直面した。

- この時点で、「東京ビッグサイト」という仮説が誤りであると判断し、その仮説を破棄して、別の可能性(幕張メッセ)へとバックトラックし、探索し直すべきだった。

しかし、AIはバックトラックせず、むしろその矛盾する情報を無理に現在の仮説に合わせ込もうとしてしまいました。これは、論理的な推論において、矛盾が生じた際に柔軟に仮説を修正し、代替パスを探索する能力がまだ十分ではないことを示している。

つまり、AIはせっかく見ている情報を生かせず、見なかった。まさに、見えているのに見えていない。

これは広義のフレーム問題に似ています。

AIは「ものづくりワールド東京」というキーワードを関連性のある情報として強く認識した。

同時に、「イオンモール幕張新都心まで750m」という地理情報も検出した。

しかし、この地理情報が「ものづくりワールド東京」の「東京」というキーワードと矛盾する、より決定的な関連性を持つ情報であるにも関わらず、その関連性を正しく評価し、優先順位を付けることができなかった。

つまり、膨大な情報の中から、特定の推論(場所の特定)に対して 「本当に意味を持つフレーム(文脈)」 を適切に設定し、そのフレーム内でどの情報が重要で、どの情報がノイズであるか、あるいは矛盾する際にどちらを優先すべきかを判断する能力が問われました。

しかし、AIはそれを適切に処理できなかった。まさに、見えているのに見えていないとはこのことです。